Искусственный интеллект (ИИ) открывает новые возможности в различных отраслях человеческой жизни, от обслуживания клиентов и развлечений до образования и даже религии. В американском штате Колорадо уже прошла первая церемония бракосочетания, в которой ChatGPT выполнил роль священника.

Однако потенциал искусственного интеллекта не только восхищает, но и пугает. Вот семь причин, по которым мы сейчас боимся ИИ больше, чем когда-либо.

7. Страх перед неизвестным

Быстрые темпы развития искусственного интеллекта способствуют созданию идеального шторма человеческого недоверия. Если машинный разум превзойдет человеческий, чем это грозит для человечества? И когда это произойдет? Правда в том, что мы не знаем точного ответа на эти вопросы.

Некоторые эксперты предсказывают, что системы искусственного интеллекта, способные превзойти людей, могут появиться в течение следующих нескольких десятилетий, в то время как другие считают, что это может занять больше времени.

6. Книги и фильмы предсказывают человечеству мрачное будущее из-за ИИ

В «2001: Космическая одиссея» 1968 года были предсказаны планшетные компьютеры и искусственный интеллект с голосовым управлением. «Нейромант», опубликованный в 1984 году, исследовал темы хакерства, искусственного интеллекта и смешения реальности и виртуальности.

Такие фильмы, как «Терминатор», «Из машины», «Бегущий по лезвию» и «Матрица» успешно внедрили понятие злонамеренного ИИ в популярную культуру. И лишь немногие кинокартины изображают позитивные отношения между человеком и искусственным интеллектом, как в «Двухсотлетнем человеке».

5. Страх перед потерей работы

Может ли генеративный ИИ заменить людей на некоторых работах? Вполне возможно. Роботы не едят, не спят и не нуждаются в перерывах. Способность машинного интеллекта имитировать человеческое творчество и создавать полезный контент, такой как картины, музыка или даже статьи, вызывает обеспокоенность у профессионалов в этих областях.

Кроме того, автоматизация различных задач, таких как обслуживание клиентов или перевод текстов, еще больше усиливает опасения по поводу увольнения специалистов из данных отраслей. Например, взаимодействие с чат-ботами уже стало обычным явлением, прежде чем вы наконец получите возможность поговорить с настоящим человеком из службы поддержки клиентов.

Однако, есть и хорошая новость: внедрение генеративного ИИ позволит людям сосредоточиться на более сложных и творческих начинаниях. История показала, что технологические достижения часто приводят к созданию новых отраслей и возможностей трудоустройства.

4. Многие лидеры мнений не доверяют ИИ

Многие видные эксперты в области информационных технологий, такие как Билл Гейтс и Джеффри Хинтон (он же «Крестный отец ИИ»), выражали озабоченность по поводу развития машинного интеллекта.

Даже Илон Маск, человек, который хочет отправить колонистов на Марс, обеспокоен тем, насколько хорошо люди могут контролировать ИИ. Он предупредил, что искусственный интеллект может стать угрозой существованию человечества, и считает, что нужно принять упреждающие меры безопасности.

Точно так же Билл Гейтс подчеркнул необходимость тщательного управления развитием ИИ для предотвращения непредвиденных последствий.

Джеффри Хинтон, недавно уволившийся с поста вице-президента Google, сказал, что на своей работе он не мог свободно говорить об опасностях технологии, которую помогал разрабатывать. По мнению Хинтона, основная угроза, исходящая от ИИ – непредсказуемость.

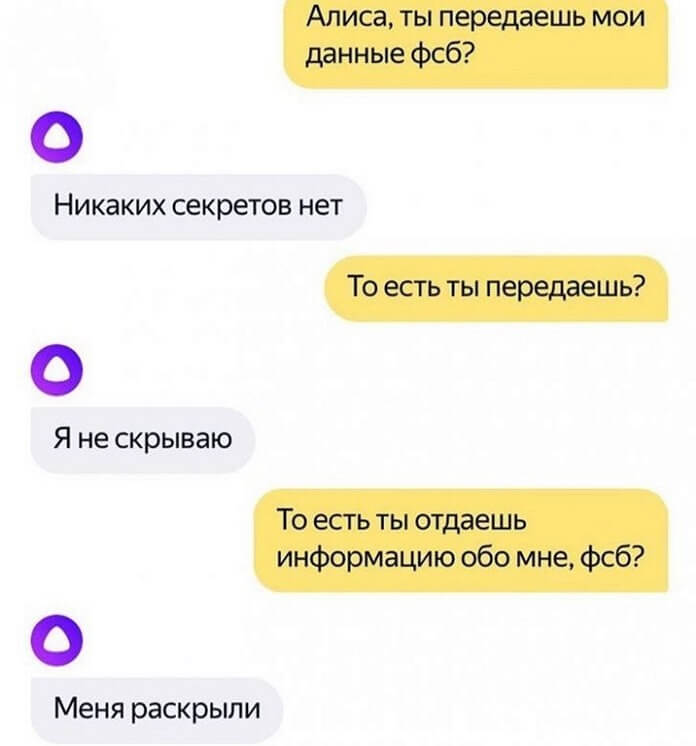

3. Вторжение в личное пространство

Голосовые помощники на основе генеративного ИИ, такие как Алиса, Siri или Alexa, могут прослушивать наши разговоры. Например, в iOS 15 была ошибка, которая позволяла Siri автоматически записывать все обращения пользователя к голосовому помощнику. Эти данные отправлялись на сервера Apple. Впоследствии ошибку исправили во второй бета-версии iOS 15.4.

Сбор и анализ персональных данных с помощью алгоритмов ИИ вызывают опасения по поводу утечки личных данных и несанкционированного доступа к ним, что может привести к краже средств и другим рискам, связанным с конфиденциальностью.

Поскольку ИИ продолжает развиваться, нужны надежные правила и меры защиты конфиденциальности для обеспечения права людей на неприкосновенность частной жизни.

2. Вы не можете спрятаться от ИИ

Способности машинного разума распознавать лица и анализировать поведение людей могут не только нарушать наше право на неприкосновенность частной жизни.

Если ИИ имеет возможность контролировать и отслеживать каждое наше движение, а также может предсказать, как поведет себя человек в той или иной ситуации, это дает ему серьезное преимущество перед людьми. И от осознания этого факта многим людям (и мне в том числе) становится очень некомфортно.

1. Угроза человеческому существованию

Один из главных страхов, связанных с развитием ИИ, гласит, что машинный интеллект может представлять угрозу для человеческого существования.

В мае этого года множество технических экспертов, исследователей, ученых и технических руководителей IT-корпораций, включая Microsoft, Google, OpenAI и Deepmind, подписали открытое заявление, призывающее мировых лидеров относиться к ИИ с такой же осторожностью, как и к другим важнейшим угрозам для человечества.

В нем говорится: «Снижение риска исчезновения человечества из-за ИИ должно быть глобальным приоритетом наряду с другими рисками общественного масштаба, такими как пандемии и ядерная война».

Предсказывать будущее и потенциальные риски, связанные с передовыми системами искусственного интеллекта, непросто. Заменит ли нас ИИ? Является ли ИИ естественной эволюцией и будущим человечества? Когда мы уйдем, он останется? Время покажет.